- terméket vagy szolgáltatást 18 éven felüliek számára

- szex, meztelenség vagy más felnőtt tartalom

- erőszakos, véres vagy arra érzékenyek számára nem megfelelő tartalom

A Black Mirror felkavaró disztópiája nem is áll tőlünk annyira messze. Néhány év múlva készülhetnek olyan AI által gyártott filmek, amelyekben nem szerepelnek igazi színészek. De mi van akkor, ha a deepfake-t nem jó dolgokra használják?

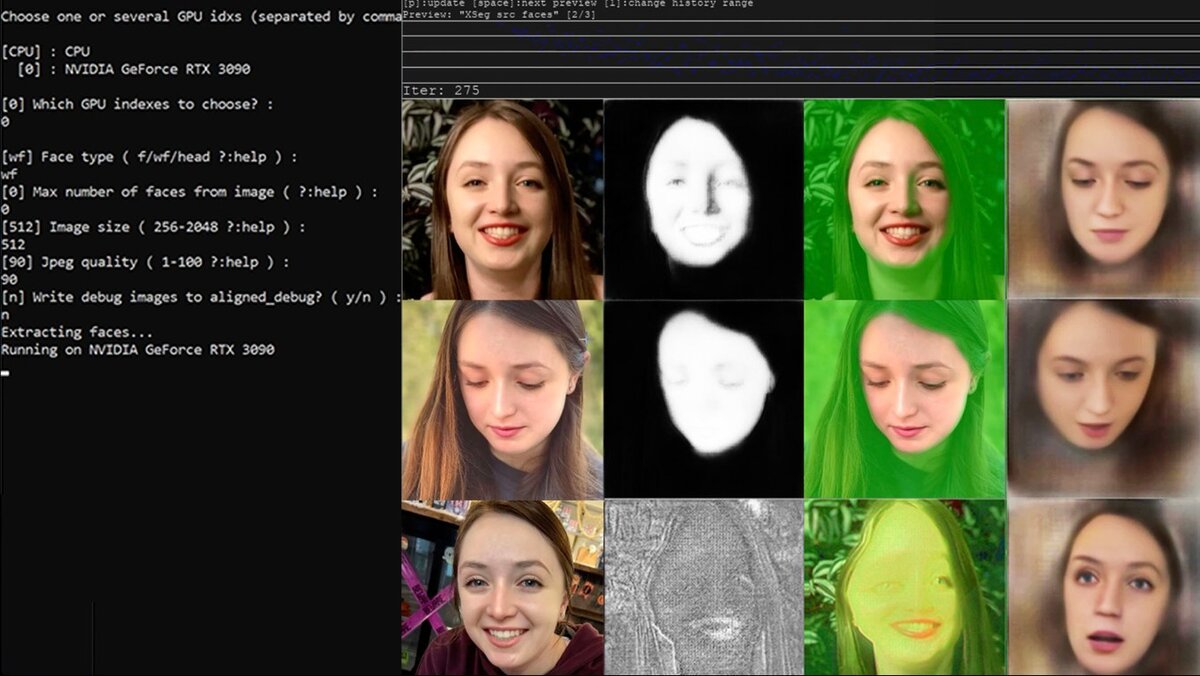

A fotómanipuláció már a 19. században is létezett. Képek meghamisításával megváltoztatni az igazságot egyáltalán nem újkeletű dolog és a mozgóképeken is hamar elkezdték alkalmazni a különböző képszerkesztő technológiákat. A deepfake azonban nem egyszerű photoshop. A deepfake tartalmak lényegében olyan fotó-, videó- vagy hangfelvételek, amelyeket a mesterséges intelligencia gépi tanulás segítségével manipulált. A technológiával egy személy (elsősorban külső) adottságai meghamisíthatóak, gyakorlatilag bárki arcmását képes egy másik, akár CGI testre ráhelyezni. A legrémisztőbb az egészben az, hogy a legújabb módszerekkel készült deepfakeknél szabadszemmel már szinte lehetetlen megállapítani, hogy valós tartalmat látunk vagy hamisítványt.

This isn’t a real PSA by Barack Obama. It’s a look into the future of fake news. https://t.co/nPAEPnabtU https://t.co/R8seLo9qaf

— BuzzFeed News (@BuzzFeedNews) April 17, 2018

2018-ban nagyot ment ez az Obamáról készült deepfake videó.

Évek óta sok szó esik a deepfake potenciális veszélyeiről, hiszen rengeteg problémát okozhat egy olyan technológia, amivel bárkivel ki lehet mondatni vagy meg lehet csináltatni bármit. Szerencsére vannak szoftverek, amelyek képesek felismerni a deepfake tartalmakat, ez azonban nem oldja meg azt a hatalmas és kevésbé elismert problémát, amit a deepfake pornó okoz.

Hamis bosszúpornó

Maga a deepfake kifejezés is pornográf tartalmak kapcsán született még 2017-ben, amikor redditezők hírességek arcával manipulált pornót kezdtek feltölteni az r/deepfake-re. A subredditet azóta törölték, azonban elindított egy óriási trendet, aminek nők százezrei estek és esnek azóta is áldozatáúl. Egy 2019-es tanulmány szerint az interneten található deepfakek 96%-a beleegyezés nélkül készült pornográf tartalom, túlnyomórészt nőkről. Számtalan deepfake pornó oldal van, amelyek a Google-n keresztül könnyedén elérhetőek és sokan gyártanak egyéni kérések alapján is személyre szóló videókat. Eleinte leginkább hírességek estek a deepfake áldozatáúl, de a deepfake tartalmat gyártók hamar elkezdték saját ismerőseik képeit is felhasználni a videókhoz. Bárki könnyedén tud pornót készíteni bosszúból vagy épp poénból valakiről, akiről van néhány fotója, és még csak túlzott technikai tudásra sincs szüksége hozzá senkinek, mivel a szoftver elintézi helyettük a piszkos munkát.

Ez a gyakorlat természetesen sérti a személyiségi jogokat, azonban nehéz fellépni ellene, a technológiai gyorsabb ütemben fejlődik, mint ahogy a jog azt követni tudja. Azt is nehéz megállapítani, hogy honnan indult egy-egy videó, így a deepfake áldozatául esettek gyakran magukra maradnak.

Az interneten egyre több nő osztja meg saját történetét a deepfake kapcsán, fórumokon, újságcikkekben hozzák nyilvánosságra, hogy miként éltek vissza a képmásukkal. Az idén megjelent Another Body című dokumentumfilm is ezt a témát dolgozza fel. Az Another Body bemutatja egy deepfake áldozat, Taylor kálváriáját, ahogyan próbálja kideríteni, hogy ki terjesztette el róla a pornográf tartalmakat és próbál jogi lépéseket tenni az ügyben. A film jól szemlélteti, hogy mennyire hosszadalmas és megalázó folyamat, amíg végre valóban foglalkozik az igazságszolgáltatás egy ilyen üggyel.

A filmben bemutatott eset sajnos egyáltalán nem egyedi, az USA-ban eddig nem volt törvényi szabályozása a deepfake pornónak, azt bárki kedve szerint legyárthatta, bármiféle következmény nélkül. Egy nemrég beadott törvényjavaslat remélhetőleg eléri a deepfake áldozatául esett nők célját és végleg betiltják az Egyesült Államokban ezeket a tartalmakat.

Bár Magyarországon nem tudni nyilvános esetekről, elképzelhető, hogy nálunk is születnek hasonló tartalmak. Ha valaki az engedélyed nélkül készítene rólad deepfake tartalmat mindenképp tegyél feljelentést vagy kérj jogi segítséget a Patent vagy a NANE nőjogi szervezetekről.